正在查看资深Hadoop商务简历模板文字版

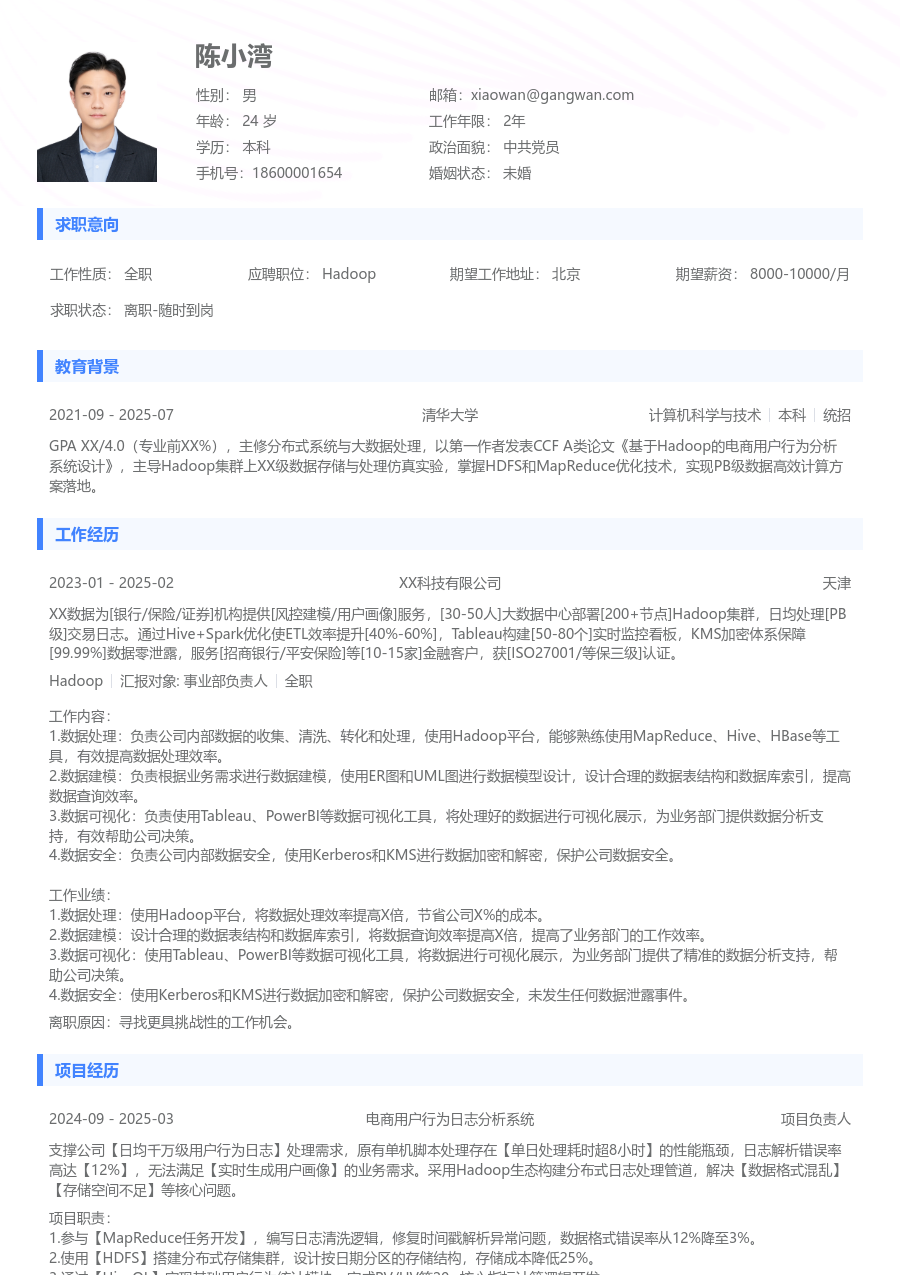

陈小湾

求职意向

工作经历

XXX数据是专注企业级大数据与人工智能服务的科技公司,团队规模约XXX人,核心业务是为金融、零售等行业客户提供数据中台解决方案与实时分析服务,产品服务于超过XXX家大型企业,与多家头部云厂商建立深度技术合作。

工作概述:

1.集群运维:负责公司核心Hadoop与Spark集群的稳定运行,制定巡检清单与告警规则,通过脚本自动化完成日常健康检查与日志分析,定期执行集群扩容与节点替换操作,将核心组件平均故障恢复时间缩短XXX%。

2.数据治理:为解决多业务线数据标准混乱问题,牵头制定数据质量与元数据管理规范,推动数据血缘图谱工具落地,建立从数据接入到产出的稽核规则,使得关键数据表的故障追溯时间减少XXX小时。

3.模型开发:基于业务方对用户行为预测的需求,使用Spark MLlib与Hive SQL开发特征工程与模型训练流水线,通过AB测试调整特征组合与算法参数,将推荐模型的准确率提升XXX个百分点。

4.作业优化:针对夜间ETL任务耗时过长的问题,分析MapReduce与Spark作业的执行计划,通过调整数据倾斜处理策略、优化Shuffle参数与资源分配,将关键报表的产出时间从XXX小时压缩至XXX小时。

5.资源管理:使用YARN与Kerberos管理多租户集群资源与权限,根据业务峰谷周期动态调整队列容量,通过资源配额与预算控制,使得整体集群资源利用率提升XXX%,并避免资源争抢导致的线上任务失败。

6.任务调度:搭建并维护基于Airflow的任务调度平台,设计任务依赖关系与失败重试机制,编写通用数据质量监控任务插件,保障每日XXX个离线任务的准时完成率维持在XXX%以上。

7.数据集成:负责将外部合作方的异构数据源接入数据平台,编写Flume采集脚本与Kafka生产者程序,处理数据格式转换与乱码问题,确保每日新增XXXGB数据稳定入库。

工作业绩:

1.独立维护XXX个节点的大数据集群,保障其XXX天持续稳定运行,支撑公司核心数据分析业务。

2.建立的数据治理体系覆盖XXX张核心表,数据质量稽核问题数季度下降XXX%。

3.主导开发并上线X个预测模型,应用于精准营销场景,直接带来季度营收增长约XXX万元。

4.完成XXX个核心ETL作业的优化,整体夜间任务执行时间缩短XXX%,节省计算成本约XXX%。

5.通过资源精细化管理,在业务量增长XXX%的情况下,年度集群硬件扩容预算节省XXX%。

6.任务调度平台管理XXX个以上任务,任务失败自动恢复成功率提升至XXX%。

7.完成X个重要外部数据源的集成,数据接入准时率达XXX%,支持新业务快速上线。

主动离职,希望有更多的工作挑战和涨薪机会。

项目经历

公司为应对金融风控业务对实时数据需求的快速增长而启动的核心项目,原有基于Hive的T+1离线数仓无法满足分钟级风险侦测要求,数据链路复杂导致开发效率低下,服务XXX家金融机构客户时,准实时数据查询延迟高达XX分钟,在业务高峰期频繁出现数据延迟告警,Flink实时计算框架与存量Kafka集群存在版本兼容性问题,状态后端稳定性不足导致任务频繁重启。

项目职责:

1.架构设计:负责实时数仓Lambda架构中实时流处理层的技术选型与核心模块设计,采用Flink替换原有Storm架构,利用Kafka+ClickHouse构建实时数据存储与查询服务。

2.开发实施:主导实时ETL管道开发,编写Flink DataStream作业处理实时交易流水,实现数据的清洗、转换与多维度聚合,将核心宽表数据实时导入ClickHouse。

3.性能调优:解决Flink任务反压与ClickHouse查询超时问题,通过优化窗口函数、调整并发度与配置合适的物化视图,将端到端数据延迟从XX分钟降至X分钟以内。

4.监控保障:搭建实时任务监控体系,集成指标报警与链路追踪,制定任务故障应急预案,确保实时数据服务可用性达到XXX%。

项目业绩:

1.成功构建分钟级延迟的实时数据仓库,支撑起XXX个实时风控规则与营销场景的稳定运行。

2.实时数据处理能力达到每秒XXX万条,支持并发查询用户数从XXX提升至XXX。

3.数据产出时效从T+1提升至分钟级,助力风控系统平均风险识别时间缩短XXX%,避免潜在损失XXX万元。

4.新架构下实时任务资源消耗降低XXX%,开发迭代效率提升XXX%,项目获得公司年度技术突破奖。

教育背景

GPA X.XX/X.X(专业前XX%),主修数据结构、数据库原理及Java高级编程等核心课程,参与校园一卡通大数据分析课程设计(使用Hadoop+Spring Boot),在团队中负责数据清洗与统计模块开发,完成百万级模拟数据的处理分析,熟悉Linux操作系统与Shell脚本编程,考取Oracle Java SE认证。

自我评价

培训经历

系统性地掌握了Hadoop分布式架构的核心原理与最佳实践,将认证所学应用于生产集群的性能优化与故障排查。通过调整HDFS块大小与机架感知策略优化了数据本地性,通过优化YARN调度器配置解决了计算资源长期碎片化的问题,使集群整体资源利用率提升了XXX%,并有效应对了数次因硬件故障导致的数据节点下线事件,保障了数据服务SLA。

资深Hadoop商务简历模板

适用人群: #Hadoop #资深[10+年]

猜你想用

关于Hadoop简历的常见问题

[基本信息]

姓名:陈小湾

性别:男

年龄:26

学历:本科

婚姻:未婚

年限:4年

面貌:党员

邮箱:xiaowan@gangwan.com

电话:18600001654

[求职意向]

工作性质:全职

应聘职位:Hadoop

期望城市:北京

期望薪资:8000-10000

求职状态:离职-随时到岗

[工作经历]

北京XX科技有限公司 | Hadoop

2024-09 - 2025-12

XXX数据是专注企业级大数据与人工智能服务的科技公司,团队规模约XXX人,核心业务是为金融、零售等行业客户提供数据中台解决方案与实时分析服务,产品服务于超过XXX家大型企业,与多家头部云厂商建立深度技术合作。

工作概述:

1.集群运维:负责公司核心Hadoop与Spark集群的稳定运行,制定巡检清单与告警规则,通过脚本自动化完成日常健康检查与日志分析,定期执行集群扩容与节点替换操作,将核心组件平均故障恢复时间缩短XXX%。

2.数据治理:为解决多业务线数据标准混乱问题,牵头制定数据质量与元数据管理规范,推动数据血缘图谱工具落地,建立从数据接入到产出的稽核规则,使得关键数据表的故障追溯时间减少XXX小时。

3.模型开发:基于业务方对用户行为预测的需求,使用Spark MLlib与Hive SQL开发特征工程与模型训练流水线,通过AB测试调整特征组合与算法参数,将推荐模型的准确率提升XXX个百分点。

4.作业优化:针对夜间ETL任务耗时过长的问题,分析MapReduce与Spark作业的执行计划,通过调整数据倾斜处理策略、优化Shuffle参数与资源分配,将关键报表的产出时间从XXX小时压缩至XXX小时。

5.资源管理:使用YARN与Kerberos管理多租户集群资源与权限,根据业务峰谷周期动态调整队列容量,通过资源配额与预算控制,使得整体集群资源利用率提升XXX%,并避免资源争抢导致的线上任务失败。

6.任务调度:搭建并维护基于Airflow的任务调度平台,设计任务依赖关系与失败重试机制,编写通用数据质量监控任务插件,保障每日XXX个离线任务的准时完成率维持在XXX%以上。

7.数据集成:负责将外部合作方的异构数据源接入数据平台,编写Flume采集脚本与Kafka生产者程序,处理数据格式转换与乱码问题,确保每日新增XXXGB数据稳定入库。

工作业绩:

1.独立维护XXX个节点的大数据集群,保障其XXX天持续稳定运行,支撑公司核心数据分析业务。

2.建立的数据治理体系覆盖XXX张核心表,数据质量稽核问题数季度下降XXX%。

3.主导开发并上线X个预测模型,应用于精准营销场景,直接带来季度营收增长约XXX万元。

4.完成XXX个核心ETL作业的优化,整体夜间任务执行时间缩短XXX%,节省计算成本约XXX%。

5.通过资源精细化管理,在业务量增长XXX%的情况下,年度集群硬件扩容预算节省XXX%。

6.任务调度平台管理XXX个以上任务,任务失败自动恢复成功率提升至XXX%。

7.完成X个重要外部数据源的集成,数据接入准时率达XXX%,支持新业务快速上线。

[项目经历]

项目名称:实时数据仓库重构

担任角色:项目负责人

公司为应对金融风控业务对实时数据需求的快速增长而启动的核心项目,原有基于Hive的T+1离线数仓无法满足分钟级风险侦测要求,数据链路复杂导致开发效率低下,服务XXX家金融机构客户时,准实时数据查询延迟高达XX分钟,在业务高峰期频繁出现数据延迟告警,Flink实时计算框架与存量Kafka集群存在版本兼容性问题,状态后端稳定性不足导致任务频繁重启。

项目业绩:

1.成功构建分钟级延迟的实时数据仓库,支撑起XXX个实时风控规则与营销场景的稳定运行。

2.实时数据处理能力达到每秒XXX万条,支持并发查询用户数从XXX提升至XXX。

3.数据产出时效从T+1提升至分钟级,助力风控系统平均风险识别时间缩短XXX%,避免潜在损失XXX万元。

4.新架构下实时任务资源消耗降低XXX%,开发迭代效率提升XXX%,项目获得公司年度技术突破奖。

[教育背景]

江苏大学

软件工程 | 本科

GPA X.XX/X.X(专业前XX%),主修数据结构、数据库原理及Java高级编程等核心课程,参与校园一卡通大数据分析课程设计(使用Hadoop+Spring Boot),在团队中负责数据清洗与统计模块开发,完成百万级模拟数据的处理分析,熟悉Linux操作系统与Shell脚本编程,考取Oracle Java SE认证。